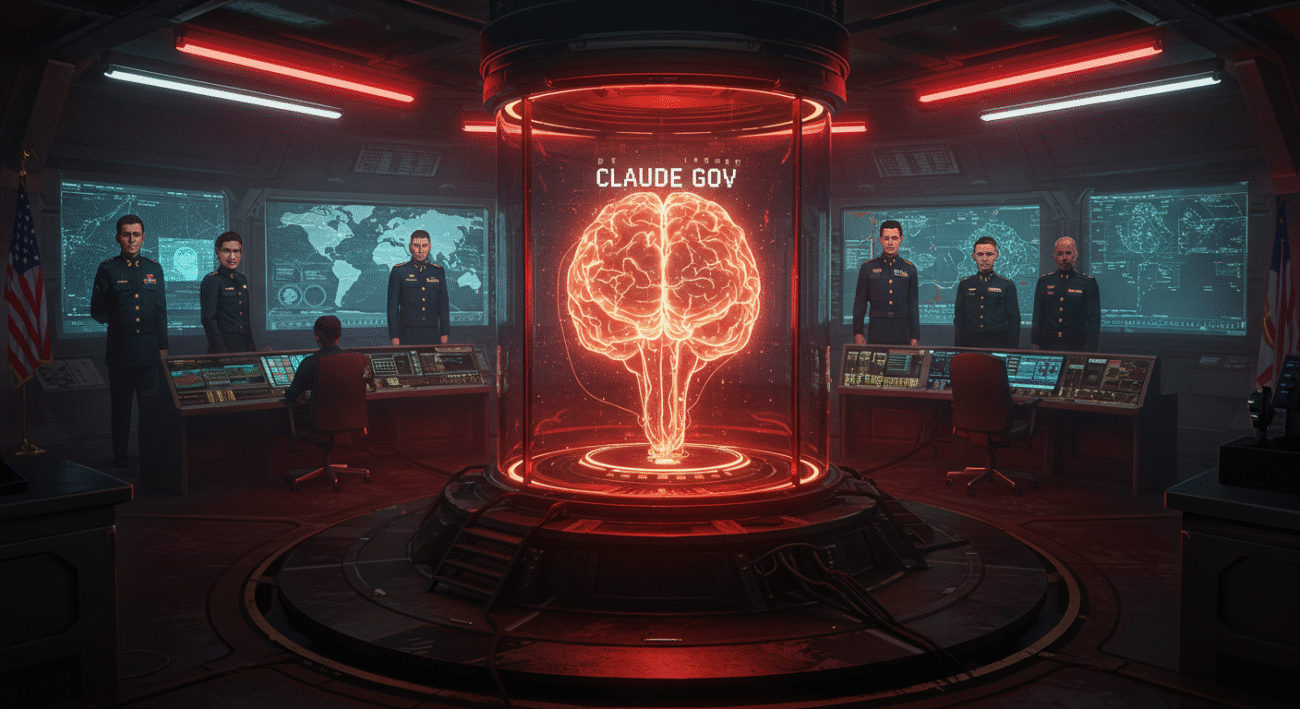

Anthropic, la compañía de inteligencia artificial respaldada por gigantes como Amazon y Google, ha dado un paso significativo en el ámbito de la seguridad nacional. Recientemente, anunciaron Claude Gov, una versión especializada de su modelo de lenguaje Claude, diseñada a medida para las necesidades de las agencias de seguridad nacional de los Estados Unidos.

¿Qué es Claude Gov?

Claude Gov no es simplemente una versión genérica de IA. Según Thiyagu Ramasamy, jefe del sector público en Anthropic, estos modelos ya están implementados por agencias del más alto nivel de seguridad nacional de EE.UU., con acceso restringido a quienes operan en entornos clasificados. Esto significa que Claude Gov está diseñado desde cero para cumplir con los rigurosos requisitos de seguridad y las necesidades operativas del mundo real de estas agencias.

Desarrollo basado en retroalimentación real

Un aspecto clave del desarrollo de Claude Gov es que se basó directamente en la retroalimentación de sus clientes gubernamentales. Anthropic afirma que el resultado es un conjunto de modelos Claude que comprenden las necesidades únicas de seguridad nacional de sus clientes, manteniendo al mismo tiempo el compromiso de la empresa con la seguridad y el desarrollo responsable de la IA.

Aplicaciones prácticas en la seguridad nacional

Las agencias de seguridad nacional de EE.UU. pueden utilizar Claude Gov en una variedad de aplicaciones críticas, que incluyen:

- Planificación estratégica: Asistiendo en la formulación de estrategias a largo plazo.

- Apoyo operativo: Proporcionando información y análisis en tiempo real para operaciones en curso.

- Análisis de inteligencia: Procesando y analizando grandes cantidades de datos para identificar patrones y tendencias.

- Evaluación de amenazas: Ayudando a identificar y evaluar posibles amenazas a la seguridad nacional.

Consideraciones éticas y de seguridad

Si bien Claude Gov mantiene las políticas de uso estándar de Anthropic que prohíben facilitar armas o sistemas dañinos, se permiten excepciones definidas para ciertas entidades gubernamentales. Sin embargo, se excluyen usos como la desinformación y los ciberataques, lo que indica un esfuerzo por equilibrar las capacidades de la IA con consideraciones éticas.

La competencia en el sector Gov de la IA

Anthropic no está solo en este espacio. La introducción de Claude Gov refleja una tendencia creciente en la integración de la IA en operaciones de seguridad nacional. OpenAI, con su ChatGPT Gov, y Scale AI, también están expandiendo sus compromisos gubernamentales. La competencia en este sector se está intensificando, con empresas de IA buscando asociaciones con agencias gubernamentales para ofrecer soluciones adaptadas a las necesidades específicas de la seguridad nacional.

Conclusión: Un paso adelante en la IA para la seguridad

La presentación de Claude Gov por parte de Anthropic representa un avance significativo en la aplicación de la IA en el ámbito de la seguridad nacional. A medida que la IA continúa integrándose en las operaciones gubernamentales, es crucial abordar las implicaciones éticas y de seguridad para garantizar que estas tecnologías se utilicen de manera responsable y efectiva.

Fuente: Expansión Tecnología

Leave a Comment